编者按: 超分辨率(Super resolution)是指通过硬件或软件的方法提高原有图像的分辨率,通过一系列低分辨率的图像来得到一幅高分辨率的图像过程就是超分辨率重建。随着视频需求不断增长,人们对于视频画质的要求也越来越高。即构科技推出的基于深度学习的自研超分技术,通过 AI 算法放大原有图像的分辨率来提升画质,有效解决了用户所面对的画质差、设备性能消耗等问题。

近日,LiveVideoStack邀请到了即构科技视频处理工程师李凯,请他来跟我们聊聊即构自研移动端实时超分辨率技术的优势与应用场景,在移动端实现此技术所遇到的挑战与困难,即构所采取的应对策略等。此外,李凯老师向我们分享了他有趣的入行经历以及学习数学对于技术的重要性,热爱阅读的他还向技术开发人员推荐了《心流》一书。

即构视频处理工程师 李凯

LiveVideoStack:李老师,您好,欢迎您参加我们的访谈,虽然您已经是我们LiveVideoStack的老朋友了,但还是请您向我们的新读者简单介绍一下自己以及您负责的工作。

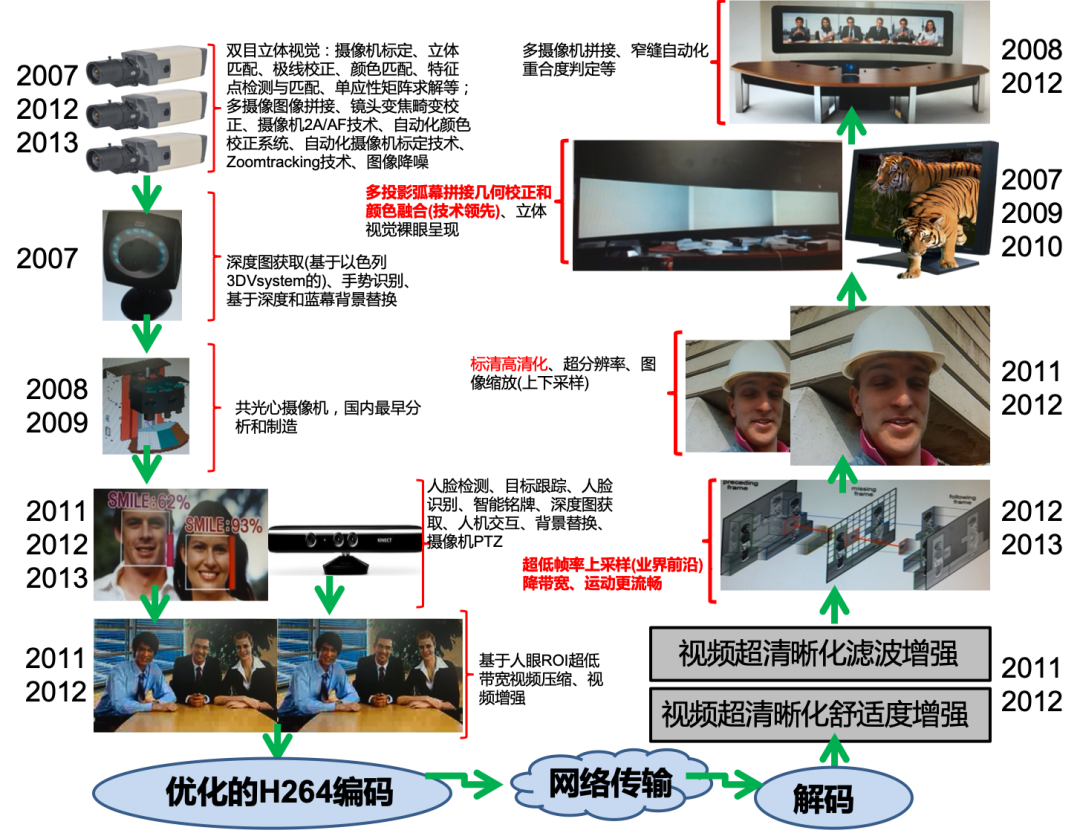

李凯: 从业视频处理18年以来,我的工作涉及单/多摄像机采集及拼接、摄像机3A、基于传统和AI的视频增强处理、极轻量级模型设计及推理框架优化、多投影仪弧幕自动拼接系统、裸眼立体显示等;署名专利100+篇,国内授权专利 80+篇,美国授权50+篇;目前任职于即构科技,主要负责视频处理业务、极轻量级模型设计及推理框架优化。

LiveVideoStack:您当初是怎么进入音视频领域的?您觉得音视频最吸引您的地方是什么?

李凯: 音视频的有趣、行业前沿,一直吸引着我。

我的入行经历如下:

2007 年搞深度摄像头、裸眼立体显示器,深度参与了端到端的裸眼立体显示和交互系统;

2008 年 ~ 2009 年,开发业界第一款共光心摄像机,解决多摄像机拼接深度层次问题;

2010 年,开发业界第一款多投影仪弧幕拼接系统;

2011 年 ~ 2013 年,进行会议系统摄像机 3A 及会议相关图像校正。

之后,负责行业第一款实时视频聊天美颜、滤镜、在线教育场景中第一个强交互伪 AI 直播的研发工作,以及至今的基于 RTC/RTE 的视频增强方案研发,音视频技术的有趣一路伴随于我。

LiveVideoStack:李老师,您大学是学数学的,又当过大学数学老师,您可不可以跟我们谈谈数学对于技术的重要性?

李凯: 我总结了四点内容:

世界上任何客观存在的事物都能用数学原理去解释,数学为解决问题提供工具,锻炼人的逻辑思维,可以将非结构化的事物最终处理为有结构的认知;

数学始终影响着我们,影响我们思考问题的角度,解决问题的方式。做事有板有眼,先确定可行性、存在性,再求解,喜欢 123 这样来讲故事,把所做的事情结构化细分,而这正是程序员们所要具备的基本素养;

搞数学和搞技术的人,都喜欢刨根问底,把道理想清楚,把技术落到需求实处;

在确定性与不确定性上,有人喜欢追求确定性,坚持非黑即白;有人创新,觉得必然会有灰度,没有百分百的确定性,否则就没有创新,比如用概率思考问题。

LiveVideoStack:我们知道您平时很喜欢阅读,可否分享一本您认为对技术开发人员很有帮助的书?

李凯: 我平常比较喜欢看心理学方面的书籍,是想不断地了解自我,用《心流》去驱动自我。

《心流》这本书告诉我们:当技能和业务需求匹配,并且及时反馈业务解决程度,码农就会处于心流状态;当技能远低于业务需求时,会焦虑,不安,躁动;当技能远高于业务需求时,会觉得无聊、无趣;在心流通道里,技能不断提升,长期乐此不疲。在焦虑和无聊状态下,很容易放弃。

程序员工作时如何进入心流状态呢?

清晰的目标,不断结构化细分工作任务;

得到立即的反馈;

能力与挑战难度相匹配,避免焦虑或无聊,进入到心无旁骛的状态,这样是个正反馈过程,而不觉得累,是不断自我更新上升。

《心流》

LiveVideoStack:我们了解到,即构科技在今年上半年推出了自研移动端实时超分辨率技术,这项技术主要用于哪些场景?它具有哪些优势?

李凯: 即构科技自研移动端实时超分辨率技术主要用于移动端实时视频通话、直播、点播等场景。

它的优势可以总结为:

更快,极低功耗,极低耗时!

更好,提升视频主观质量!

更低,结合编解码,实现高清画质下的极低码率!

更广,覆盖更多机型!

LiveVideoStack:在移动端实现实时超分辨率技术,主要有哪些难点?即构又是如何克服的?

李凯: 如何让超分在移动端实时跑起来是一个巨大的挑战:

首先,移动端实时视频分辨率比较低(640x480 左右),而移动手机显示屏分辨率一般都比较高(1920x1080,甚至到 2340x1080),如 Apple 13 Pro Max 显示屏分辨率为 2778 x 1284;

其次,每帧处理耗时要低于30毫秒(640x360 超分到 1280x720),否则会有明显的卡顿;

最后,超分处理后,相对于没开启超分,图像或视频是要有明显的主观、客观的质量提升。

那么,基于深度学习的超分网络模型设计也需要面临挑战:

挑战一:网络模型参数量过大,一般都大于 500K;

挑战二:模型运算量过大,推理时非常慢,一般都大于 100G FLOPs;

挑战三:超分区别于其他计算机视觉如目标检测与跟踪技术,不能对输入的图像或视频进行缩小;

挑战四:同一模型不同Mobile GPU上运行,性能峰值差异大。

即构在面临上述四个挑战时,做了如下研究:

指导模型设计:什么样的模型才是最好的匹配移动端的候选网络模型,以减少训练次数;

极轻量级模型设计:在适配移动端设备时,主客观效果相对于大模型不显著下降,且显著优于传统插值放大算法;

模型量化压缩及加速,及工程化;

基于 Roofline 理论,度量 Mobile GPU 特性,优化推理引擎,动态调整,提升运算峰值。

LiveVideoStack:2022年下半年,您将在视频技术上有哪些新的想法?

李凯: 无论基于传统还是 AI 的技术,最难的都是如何在覆盖机型广的情况下,能够在移动端实时跑起来。

视频处理技术,一般都是参考前后帧间的运动信息,无论是块匹配还是光流,带来的运算是巨量的,如何设计极轻量级的网络模型或者在不真正计算运动或光流信息的情况下,迅速获得帧间对应关系,同时获得性能和效果的折中,是每一位从业人员面对的难题。

简述就是:

如何设计目标平台的网络结构:结合 Roofline,Mobile GPU 硬件算力,推理引擎的特点,设计极轻量级的网络模型,而该模型在不同的 Mobile GPU 均能达到当前运算峰值;

如何计算帧间信息:参考帧间的光流信息(计算与不计算)而获得帧间运动物体的信息。

如何度量:以人眼感观效果为主,而不是客观评价值。

LiveVideoStack:在视频处理技术领域,未来5到10年,您认为还会出现哪些大的创新?AI 技术在其中又会发挥什么样的作用?

李凯: 首先,在未来基于 AI 技术,视频处理在各行业应用具有巨大的潜力,如安防、智能制造、医疗、教育、电商零售和金融等各行业垂直领域,也会在行业应用中创新。

视频处理技术在移动端耗费巨大算力,必然会在未来提升 NPU 算力,以支持各种视频处理业务,而 AI 芯片关键在于成功整合软硬件,我们即构也在和芯片厂商合作,共建生态。

在一些 VR/AR 场景中,AI 会让交互变得高度自然。

不过 AI 自主学习是终极目标,短期内如小孩智力,但会快速成长到成人智商。

LiveVideoStack:您进入音视频领域已经有 18 年时间了,对于整个行业的发展,您有什么样的愿景?

李凯: 我希望行业能够不断提升技术价值、推进 AI 技术发展,并将 AI 技术与音视频最大限度结合:

技术价值,只有服务于用户,才是有价值的技术,普及更多的用户,才能价值扩大化;

AI 技术, 性能最小化,效果最大化,渐进往端上设备迁移,渐进落实到芯片中;

AI 技术促进音视频技术,让音视频更加清晰、流畅、稳定。

LiveVideoStack:您将参加在上海举办的 LiveVideoStackCon2022 音视频技术大会,您是否可以透露一下,会上将做哪些分享?

李凯: AI 技术落地是渐渐地从服务器端、云端落地,逐步到移动端及边缘设备上。随着这些年AI技术的进步,轻量级算法模型在移动端实时跑起来,移动端算法在不断迭代和完善,而对于实时直播场景,越来越多的 AI 算法落地,如:基于人脸的各类娱乐玩法、人体姿态识别、背景替换等。

随着算法不断完善、硬件能力的不断提升,基于 AI 的实时视频增强处理技术也落地于实时直播或视频通话场景。而对于很多涉及隐私的场景,越来越多的用户期望AI技术能够本地化,不经过云端。针对消耗更多算力的视频云转码,在面对移动端本地化需求时,我们即构科技提出一套极轻量级 AI 算法模型,结合移动端硬件特性,差异化优化前馈推理库,让算法模型、推理库、硬件成为一体,使得视频云转码移动端化成为可能。我将在大会上对此进行分享。

* 封面图来自Unsplash,By Frederick Medina